Nvidia começa produzir "superchip" que unifica GPU e CPU

Por Renan da Silva Dores • Editado por Wallace Moté | •

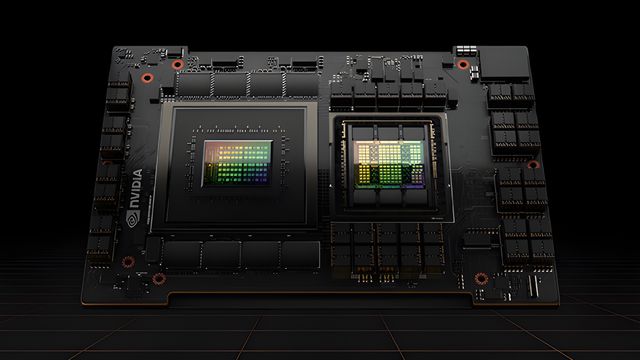

Além de trazer novidades de IA Generativa para o mundo dos games, a Nvidia confirmou que o GH200 Grace Hopper, seu superchip que combina CPU e GPU de última geração em um único pacote, entrou na fase de produção em massa, devendo estrear nos próximos meses em servidores de gigantes como ASUS e Gigabyte. Junto do componente, a companhia confirmou ainda a estreia de um novo supercomputador com 256 unidades do GH200, um servidor mais flexível e uma plataforma de comunicação mais veloz para data centers baseada em Ethernet.

- Intel x86S: nova arquitetura 100% 64-bit promete acelerar seu PC

- TeamGroup revela SSD PCIe 5.0 com 14 GB/s e water cooler

Nvidia GH200 Grace Hopper entra em produção

Quando anunciou a H100 em março de 2022, a Nvidia apresentou uma solução ainda mais ambiciosa na forma do Grace Hopper Superchip, um acelerador que combinava em um mesmo pacote a H100 com o Nvidia Grace, a CPU de 72 núcleos Neoverse V2 para servidores da marca baseada na arquitetura ARM. A proposta era bastante extrema ao usar a conexão especial NVLink C2C, com velocidade de 900 GB/s (7 vezes mais veloz que o PCIe 5.0), para possibilitar a comunicação de CPU e GPU.

Segundo a Nvidia, a dupla seria capaz de oferecer até 284 vezes mais desempenho que uma CPU x86 tradicional no treinamento de LLMs (Grandes Modelos de Linguagem, como os usados pelo ChatGPT), ou mesmo 2,3 vezes mais poderosa em comparação a uma CPU x86 com a própria H100 sozinha.

O segredo estaria na comunicação mais veloz proporcionada pelo NVLink C2C, a melhor integração de software e, principalmente, o grupo de memória unificada que o combo CPU + GPU teria acesso (480 GB LPDDR5X da CPU + 96 GB HBM3 da GPU).

No anúncio feito na Computex 2023 nesta segunda-feira (29), a empresa confirmou o nome oficial do superchip — Nvidia GH200 Grace Hopper — e revelou que a solução acaba de entrar em fase de produção em massa. Isso significa que, nos próximos meses, os primeiros servidores equipados com o GH200 começarão a ser anunciados, com alguns deles já estando em demonstração na Computex.

A Nvidia afirma que mais de 400 sistemas serão equipados com o superchip, vindos de fabricantes renomadas como ASRock Rack, ASUS, Dell Technologies, Gigabyte, Lenovo, Pegatron e Supermicro, entre outras. Como os clientes são centros de pesquisa e grandes companhias, preços não foram anunciados — os valores devem variar conforme as personalizações de cada cliente.

DGX GH200 é supercomputador focado em IA

Aproveitando a nova etapa do GH200 Grace Hopper, a Nvidia apresentou o DGX GH200, um supercomputador focado em Inteligência Artificial que combina 256 unidades do GH200. A máquina é um verdadeiro monstro de computação ao prometer 1 ExaFLOP de poder computacional de IA (o equivalente a mais de 1.000 PetaFLOPs, ou ainda 1.000.000 TeraFLOPs) e 144 TB de memória unificada, com todas as GPUs funcionando como uma só graças ao novo sistema NVLink Switch, que seria 48 vezes mais veloz que a geração anterior.

Além do poder extremo, o DGX GH200 traz mais alguns aspectos interessantes: o time verde garante que, apesar da complexidade da infraestrutura do hardware, programar software para o supercomputador funcionaria como produzir um programa para uma única GPU. Além disso, cada uma dessas máquinas vai funcionar como uma espécie de "peça de Lego", permitindo que os clientes (grandes empresas e plataformas de computação na nuvem) possam combinar múltiplos DGX GH200 para obter maior potência.

Para servir de referência, a própria Nvidia está construindo um supercomputador tirando proveito desse conceito, o Nvidia Helios, que será utilizado nas pesquisas e projetos futuros dos desenvolvedores da marca. O Helios unirá quatro DGX GH200 para atingir 1.024 superchips Grace Hopper, 576 TB de memória unificada e 4 ExaFLOPs de poder computacional.

De acordo com o anúncio, algumas companhias terão acesso antecipado ao novo DGX, incluindo Google Cloud, Meta e Microsoft, mas outras empresas devem trabalhar com o hardware. Tanto o Nvidia Helios quanto outros supercomputadores baseados na novidade estão previstos para entrar em funcionamento até o fim de 2023.

Novo servidor MGX oferece mais flexibilidade

Para servidores mais "simples", que trabalham com modelos de IA mais básicos e tarefas mais generalizadas de data center, incluindo streaming e pesquisas científicas, a Nvidia oferece o HGX H100. Trata-se de um servidor que integra até duas CPUs (Nvidia Grace ou rivais da AMD e Intel) com até oito GPUs H100, unificadas em uma mesma placa cuja comunicação é feita por meio do NVLink citado anteriormente.

Como a descrição sugere, os clientes (as empresas) têm menos flexibilidade de fazer upgrades, já que as GPUs estão fixadas na mesma placa, nem podem aproveitar peças dos servidores que já possuem. Para contornar tal limitação e atender a esse público, a Nvidia apresentou o MGX, cujo diferencial é justamente oferecer a flexibilidade que o HGX não entrega. A empresa promete mais de 100 variações para segmentos como ciência de dados, treinamento de LLMs, design, e processamento gráfico e de vídeo (incluindo streaming de games).

Conforme a explicação, os clientes começarão com um chassi básico predefinido, e então selecionarão as CPUs, GPUs e DPUs (Unidade de Processamento de Dados, responsável por trabalhar no tráfego de dados) que preferirem.

No portfólio estarão presentes chassis de 1U, 2U e 4U (define a quantidade de "gavetas" do rack que o servidor vai ocupar) com resfriamento líquido ou a ar, GPUs Nvidia como a H100, a L40 e L4, CPUs GH200 Grace Hopper, Grace Superchip e soluções AMD e Intel, bem como os adaptadores de rede mais recentes da Nvidia.

A QCT e a Supermicro serão as primeiras fabricantes de servidores a oferecer projetos baseados no MGX, com lançamento previsto para agosto. Dois deles já foram mostrados: o S74G-2U da QCT, que usa o GH200 Grace Hopper, e o ARS-221GL-NR da Supermicro, com um Grace Superchip (duas CPUs Grace unidas pelo NVLink C2C, totalizando 144 núcleos).

Melhor integração com nova plataforma Ethernet

Completando as novidades para servidores focados em IA Generativa, a Nvidia apresentou uma nova plataforma de comunicação para a nuvem baseada em Ethernet (o cabo de rede), a Nvidia Spectrum-X. Assim como os outros dispositivos revelados nesta segunda (29), a Spectrum-X é uma combinação de tecnologias da gigante: temos o casamento de um Nvidia Spectrum-4 Ethernet switch (o equipamento que distribui os dados em diferentes portas Ethernet) com a DPU BlueField-3 e o conjunto de software da Nvidia.

Pensado especificamente para tarefas de IA, bastante sensíveis à velocidade do tráfego de dados, o Spectrum-4 sozinho entrega taxas de transferência de 51 Tb/s. Inserido na plataforma Spectrum-X, isso resulta em até 256 portas Ethernet de 200 Gb/s cada — em comparação, um desktop comum costuma trazer portas Ethernet de apenas 10 Gb/s, ou mesmo de 2,5 Gb/s. O lançamento é compatível com outras switches baseadas em Ethernet, e pode ser adaptada para oferecer até 16 mil portas, dependendo da necessidade do cliente.

A Nvidia Spectrum-X já está disponível através de soluções oferecidas por Dell Technologies, Lenovo e Supermicro.

Nvidia H100 tem data para ganhar sucessora

Concluindo sua grande conferência na Computex, a Nvidia confirmou que a sucessora da H100, chamada no momento de "Hopper Next" (com Hopper sendo uma referência à arquitetura Hopper usada pela H100), será apresentada em 2024. Mesmo que não tenha trazido informações técnicas ou previsões mais precisas de desempenho, a confirmação é importante por assegurar que o ciclo de dois anos para cada arquitetura será mantido, depois de alguns tropeços ocorrerem nos planos da empresa.

Rumores já sugerem que a arquitetura da próxima geração deve se chamar Blackwell, com ao menos dois chips estando em desenvolvimento: o GB100 e o GB102. Ambos seriam fabricados usando uma litografia customizada, baseada no processo N3 da TSMC, da classe de 3 nm. Outros aspectos, incluindo performance ou a possibilidade da tecnologia ser trazida a uma eventual família GeForce RTX 5000 para games, seguem desconhecidos. A Nvidia deve divulgar mais detalhes nos próximos meses.