IA ameaça humanidade como pandemias e guerra nuclear, alertam especialistas

Por Alveni Lisboa • Editado por Douglas Ciriaco |

O potencial destrutivo de inteligências artificiais, como ChatGPT e Bard, é igual a uma guerra nuclear ou uma pandemia. A afirmação apocalíptica veio de um grupo de empresários e líderes do setor chamado Center for AI Safety, organização cuja missão é “reduzir os riscos em escala social da inteligência artificial”.

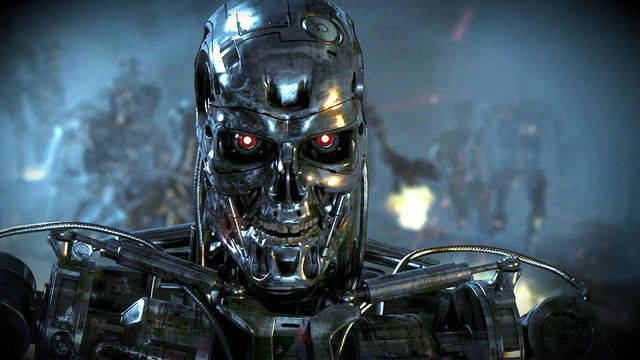

Segundo esses especialistas, a prioridade do mundo atual deve ser mitigar o risco de extinção que poderia ser causado por um descontrole do setor. Isso não tem nada a ver com robôs exterminando pessoas ou ganhando consciência, como Stephen Hawking e outros previram, mas sim com os impactos decorrentes do uso da tecnologia.

"Mitigar o risco de extinção da IA deve ser uma prioridade global, juntamente com outros riscos em escala social, como pandemias e guerra nuclear", diz o trecho de abertura do abaixo-assinado.

Além dos riscos atuais, como uso indevido para fins de desinformação e deepfakes, os modelos de IA poderiam mudar drasticamente setores da sociedade. Dois nichos profissionais que devem ser severamente impactos é a área criativa (arte, literatura, ensino) e as atividades manuais (atendimento, construção, montagem).

“Especialistas em IA, jornalistas, formuladores de políticas e o público estão discutindo cada vez mais um amplo espectro de riscos importantes e urgentes da IA. Mesmo assim, pode ser difícil expressar preocupações sobre alguns dos riscos mais graves da IA avançada", ressalta a introdução da declaração.

Quem são as pessoas que assinam o documento?

Entre os signatários da mensagem estão o CEO da OpenAI, Sam Altman, e o chefe da DeepMind — empresa do grupo Google —, Demis Hassabis. Os pesquisadores vencedores do Prêmio Turing, Geoffrey Hinton e Yoshua Bengio, considerados por muitos como os padrinhos da IA moderna, também assinaram o documento.

Esta é a segunda declaração assustadora de grupos que atuam no setor desde a explosão do ChatGPT, em dezembro de 2022. Em março, mais de 1 mil influentes personalidades do setor, incluindo Elon Musk e Steve Wozniak, pediram uma pausa de seis meses no treinamento de IAs para a criação de normativos sobre a tecnologia.

O próprio dono da empresa criadora do ChatGPT já pediu a governos do mundo inteiro que criem órgãos reguladores e legislações específicas para coibir aventureiros no segmento. Somente as companhias devidamente autorizadas e comprometidas com princípios éticos poderiam criar modelos de IA, já que todos os procedimentos seriam gerenciados por um organismo autônomo.

Regulamentação de IAs não evolui

Os políticos parecem não estar muito preocupados com o potencial destrutivo das IAs. Nos Estados Unidos, país que concentra a maioria das empresas do segmento, o presidente Joe Biden ainda tem dúvidas sobre os perigos.

Para Biden, “as empresas de tecnologia têm a responsabilidade” de garantir que os produtos “sejam seguros antes de torná-los públicos”. O político ainda não disse se pretende acatar o pedido de representantes do setor de IA, como a OpenAI e a Microsoft, de criar um órgão regulador.

Aqui no Brasil, existe um projeto de lei apresentado pelo presidente do Congresso Nacional, senador Rodrigo Pacheco, que trata do assunto. Não há, contudo, nenhuma movimentação dos parlamentares para votação da proposta.