Midjourney cita "abuso" e encerra acesso gratuito

Por Alveni Lisboa • Editado por Douglas Ciriaco | •

O aplicativo de inteligência artificial Midjourney vai encerrar seu serviço de geração gratuita de imagens em razão do que entende como uso abusivo da ferramenta. Nas últimas semanas, várias imagens de deepfake criadas com a IA tomaram a internet e causaram muita confusão.

- Papa apoia uso de IA, mas pede ética e responsabilidade

- Serviço oferece modelos gerados por IA para publicidade

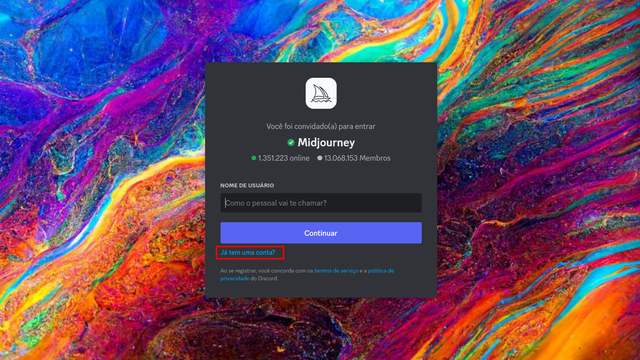

O CEO do Midjourney, David Holz, disse no Discord que a empresa encerrará o acesso gratuito ao programa por causa da “demanda extraordinária” e de “abuso” cometido pelos usuários. Mesmo com ajustes recentes, as medidas não teriam sido suficientes para barrar o uso indevido, explicou o executivo.

Quem quiser usar o app para gerar imagens a partir de texto deverá pagar ao menos US$ 10 (cerca de R$ 52) por mês. Esta também pode ser uma forma de monitorar o uso da ferramenta, pois é mais simples rastrear a origem das imagens em contas pagas.

A maior dificuldade é que o modelo de IA tem evoluído cada vez mais, ao ponto de gerar imagens muito realistas. O foco agora, analisou Holz, é usar o dinheiro arrecadado com as assinaturas para melhorar a moderação e passar a detectar melhor os abusos.

Midjourney no centro das atenções

Imagens do ex-presidente dos Estados Unidos Donald Trump preso e do Papa Francisco com um casaco estiloso rodaram o mundo. Houve uma imediata identificação da falsificação, inclusive por autores dos posts, mas muita gente ficou confusa com as fotos.

Os casos colocaram o Midjourney sob holofotes de maneira bem negativa. A plataforma chegou a bloquear alguns termos específicos para evitar imagens baseadas em personalidades, mas isso não tem sido suficiente para barrar os deepfakes.

A solução para o app deve passar por barrar o uso de certas palavras-chaves, como o nome de celebridades, políticos e outras pessoas reais. A OpenAI impede a criação de conteúdo sobre eventos políticos, sexo ou erotismo e teorias conspiratórias no DALL-E.

Já o concorrente Stable Diffusion, da Stability AI, bloqueia os conteúdos chamados NSFW (sigla em inglês que significa "inapropriado para o ambiente de trabalho"), o que engloba violência, sexo, drogas e outras temáticas impróprias para se ver em público. O serviço também bloqueia palavras relacionadas a tais tópicos para impedir a geração indevida.

Moderação de conteúdos de IAs

Mesmo com tais medidas, ainda é possível criar conteúdos enganosos usando outros artifícios. Assim como nos chatbots de texto, existe uma imensa dificuldade em moderar conteúdo de IAs, porque as pessoas buscam alternativas para burlar as amarras.

Há também outro fator que preocupa muito o setor: o roubo de direitos autorais. Artistas do mundo inteiro reclamam de ter seu estilo reproduzido por robôs e vendidos por usuários com índole maliciosa.

Os desafios só estão começando e banir o uso gratuito provavelmente não vai resolver o problema.