Governo dos EUA apresenta diretrizes para regulamentação da IA

Por André Lourenti Magalhães • Editado por Douglas Ciriaco | •

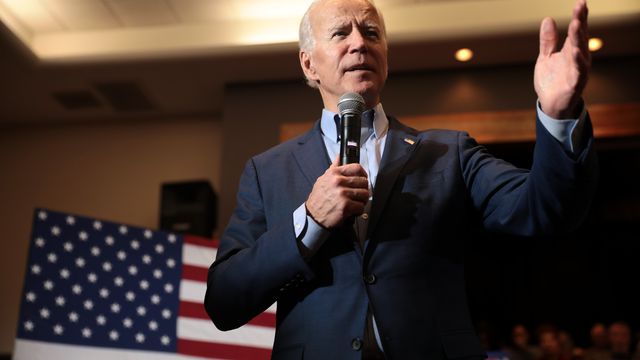

O presidente dos Estados Unidos, Joe Biden, assinou uma ordem executiva que destrincha seus planos para regulamentar as empresas de inteligência artificial no país. O documento, publicado pela Casa Branca na última segunda-feira (30), prevê padrões para garantir segurança das ferramentas, reforçar a privacidade, preservar direitos civis e evitar desinformação, entre outros aspectos.

- Google vai investir US$ 2 bilhões na Anthropic, rival da Open AI

- OpenAI forma time para evitar apocalipse causado por IA

A ordem executiva demanda que empresas do segmento, como Meta, Google e OpenAI enviem resultados de testes das ferramentas de IA para o governo do país norte-americano. No entanto, a medida ainda não funciona como uma nova lei: para isso, precisaria de aprovação do Congresso dos EUA e o cenário no parlamento ainda não seria suficiente para o presidente conquistar os votos necessários.

Diretrizes para regulamentar IAs nos EUA

O conjunto de normas para regulamentar as IAs nos Estados Unidos tem oito objetivos principais, segundo o documento revelado pela Casa Branca:

- Criar novos padrões de segurança para IA;

- Proteger a privacidade dos usuários;

- Garantir avanços de equidade e direitos civis;

- Proteger consumidores, pacientes e estudantes;

- Apoiar trabalhadores;

- Promover inovação e competição;

- Ampliar a liderança dos EUA nas tecnologias de IA ao redor do mundo;

- Garantir o uso responsável e eficaz de IA pelos órgãos governamentais.

A fiscalização é dividida entre diversas instituições do governo federal. O Instituto Nacional de Normas e Segurança (NIST) é responsável por desenvolver os padrões de construção de novos modelos de IA, enquanto o Departamento de Comércio vai criar guias para verificar conteúdos gerados por IA.

Além disso, o Departamento de Energia e o Departamento de Segurança Nacional vão analisar os possíveis riscos da inteligência artificial para a cibersegurança e para usos químicos, biológicos e até nucleares da tecnologia. Todos os órgãos federais têm um prazo de 270 dias para criar todas as diretrizes, começando a partir de 30 de outubro de 2023.

Ordem não afeta IAs existentes

A medida vale apenas para novas ferramentas de IA em desenvolvimento: em comentário ao The Verge, um funcionário do governo afirmou que não serão exigidas as diretrizes para modelos já disponíveis ao público.

Portanto, a nova ordem executiva deve ser aplicada como uma medida a longo prazo — não dá para saber se ela afeta IAs em fase de testes, como é o caso do Gemini, do Google.

Governo dos EUA dá primeiro passo na regulamentação

Apesar de não funcionar como uma nova lei, a ordem executiva é um aceno significativo do presidente Joe Biden para a regulamentação da IA. As principais empresas do segmento estão sediadas nos EUA, como é o caso de Alphabet (proprietária do Google), Meta, Microsoft e OpenAI, logo precisariam seguir as diretrizes e isso invariavelmente impactariam usuários de outras partes do mundo. Por outro lado, a batalha de Biden com o Congresso pode dificultar novos avanços.

A regulamentação de IA em termos de segurança, privacidade e desenvolvimento de novas ferramentas é um ponto defendido por nomes importantes no mercado, como Microsoft e OpenAI. Com relação às legislações, o parlamento da União Europeia já desenvolve uma série de leis sobre o uso da tecnologia, o chamado AI Act.

É importante mencionar ainda que o documento foi publicado dias antes da visita da Vice-Presidente dos EUA, Kamala Harris, à primeira cúpula global de Inteligência Artificial, organizada pelo governo do Reino Unido. O evento é realizado a partir desta quarta-feira (1º) e conta com representantes governamentais e das principais empresas de tecnologia do ramo.