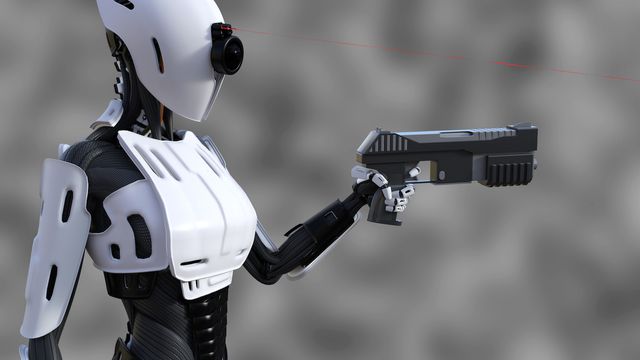

Tecnologia autônoma que identifica tiros erra e faz homem ser preso injustamente

Por Alveni Lisboa • Editado por Douglas Ciriaco | •

Um sistema de inteligência artificial (IA) usado em algumas cidades dos Estados Unidos causou um transtorno irreparável a um cidadão inocente: ele foi parar na cadeia em razão de falha da tecnologia. Segundo a agência Associated Press, Michael Williams, de 65 anos, foi falsamente acusado de assassinato em agosto passado e permaneceu um ano inteiro na prisão, tudo por culpa de uma IA problemática.

- Rede neural artificial inspirada no cérebro humano consegue "pensar" melhor

- IA inventa produto, mas entidades não querem registrar a patente; entenda o caso

- Cientistas criam IA para prever as próximas grandes novidades em tecnologia

O ShotSpotter é um sistema de detecção de tiros criados para monitorar disparos em regiões violentas. Quando identifica um som similar ao de uma arma, mapeia a região com base na geolocalização sonora e envia um comunicado para as autoridades, que vão até o local para averiguar o caso.

Nesta situação mencionada, o homem foi levado direto para a cadeia e só foi libertado após a promotoria desistir do caso por falta de provas. A Associated Press afirma que os funcionários da ShotSpotter, cientes do erro da ferramenta, ainda alteraram manualmente o local de onde os sons de tiro vieram para favorecer o seu produto.

Conforme apuração, o sistema é falho até para detectar tiros bem abaixo dos seus microfones de captação, sem contar a existência de relatos de falsos positivos com fogos de artifício ou escapamentos barulhentos de automóveis mais antigos. Quando isso ocorre, se houver alguém por perto, a chance de ser falsamente acusado é grande, especialmente em comunidades compostas por negros e latinos, onde a IA se fortalece lado a lado com o racismo e a xenofobia.

Combate ao crime informatizado

Tecnologias como essa têm ganhado espaço junto a autoridades policiais, em especial nos EUA, para coibir a prática criminosa sem colocar a vida de policiais em risco. O problema é que ela não estaria sendo capaz de reduzir a violência com armas de fogo ou assassinatos — nem sequer a apreensão de armas foi ampliada.

A matéria original ainda ressalta que criadora do sistema de IA tem feito de tudo para mascarar o funcionamento da sua tecnologia, sem permitir o acesso de investigadores e advogados ao código da solução. Do ponto de vista jurídico, isso é um baita problema: de um lado, há um acusado humano, falho, enquanto do outro está uma máquina que supostamente não deveria errar de forma tão gritante.

Advogados de defesa de acusados reclamam da falta de provas sólidas e alegam que inocentes estão indo para a cadeia somente por ilações. Eles reclamam de falta de validação por especialistas confiáveis da técnica usada pelo ShotSpotter, o que prejudica a confiabilidade do sistema. Ainda que tudo seja revisto, é surreal imaginar que uma pessoa possa ser recolhida à prisão com base em apenas um barulho, que pode ser de dezenas de outras coisas.

Esse é um dos primeiros casos em que uma IA de segurança pública causa transtornos para inocentes, mas não deve ser o último. Com o aumento da criminalidade em vários locais, os departamentos de polícia apostarão nas inteligências artificiais para solucionar e evitar crimes, o que não essencialmente ruim, mas precisa ser conduzido com muita cautela e atenção à ética para que o sonho do combate eficaz à violência não se torne um pesadelo para grupos já marginalizados.

Fonte: Associated Press