O que é e como funciona o Seedance 2.0?

Por Viviane França • Editado por Bruno De Blasi |

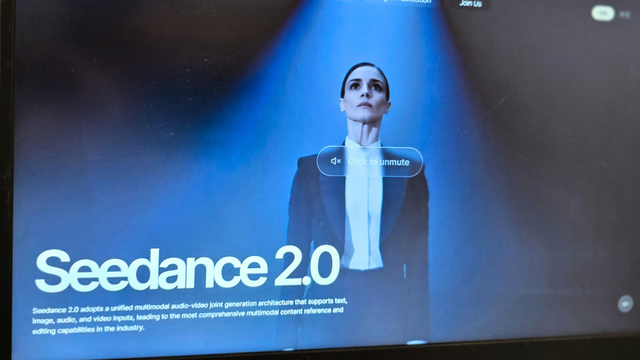

O Seedance 2.0 é um modelo avançado de inteligência artificial desenvolvido pela ByteDance para gerar vídeos com áudio sincronizado. Ele consegue processar texto, imagem, vídeo e som em um único comando para criar conteúdos com aparência cinematográfica e alto nível de controle criativo.

- Qual é a melhor IA para criar vídeos? 4 diferenças entre o ChatGPT e o Gemini

- Como usar o Vibes? Novo app da Meta cria vídeos com IA

A seguir, tire suas dúvidas sobre:

- O que é Seedance 2.0?

- Para que serve o Seedance 2.0?

- Como o modelo funciona?

O que é Seedance 2.0?

O Seedance 2.0 é o novo modelo de criação de vídeo desenvolvida pela divisão de pesquisa em IA da ByteDance, a ByteDance Seed. Com ele, é possível produzir vídeos a partir de texto, imagens, vídeos e áudio, com movimentos naturais, som sincronizado e boa continuidade entre as cenas.

Para que serve o Seedance 2.0?

O Seedance 2.0 serve para criar e editar vídeos com qualidade cinematográfica usando inteligência artificial. Ele pode ser usado para:

- Criar vídeos publicitários;

- Produzir cenas para cinema e entretenimento;

- Gerar demonstrações de produtos para e-commerce;

- Desenvolver trailers e conteúdos para jogos;

- Criar vídeos curtos para redes sociais com áudio sincronizado.

Além de gerar vídeos do zero, o modelo também funciona como uma ferramenta de edição. É possível fazer ajustes específicos, como alterar apenas um personagem ou uma ação sem mexer no restante do conteúdo, e conta com a função de extensão para continuar a cena além dos 15 segundos iniciais.

Como o modelo funciona?

O Seedance 2.0 utiliza uma arquitetura multimodal unificada baseada em modelos de linguagem de grande escala, o que permite gerar vídeo e áudio ao mesmo tempo. Por isso, o modelo entende que o som precisa acompanhar o que acontece na cena.

O treinamento conjunto também ajuda a manter a consistência das cenas. Assim, o Seedance 2.0 consegue manter personagens, iluminação e cenário estáveis mesmo com trocas de câmera, preservando a continuidade por até cerca de 15 segundos.

Inclusive, o modelo corrige falhas comuns em IAs, como objetos que se deformam ou movimentos que ignoram a gravidade, e consegue representar interações complexas entre vários personagens com mais realismo, como em uma cena de patinação no gelo.

Além disso, o sistema consegue processar mais de uma referência ao mesmo tempo. Em uma única geração, o usuário pode inserir até 9 imagens, 3 vídeos, 3 áudios e comandos em texto.

Com relação ao som, o Seedance 2.0 gera áudio estéreo para criar uma experiência mais imersiva. Também é capaz de reproduzir detalhes sutis, como o atrito de tecidos, o arranhar de uma superfície ou o estalo de plástico bolha.

Confira outros conteúdos do Canaltech: