GPU para IA Nvidia H200 tem 141 GB de memória e 4,8 TB/s de largura de banda

Por Daniel Trefilio • Editado por Jones Oliveira |

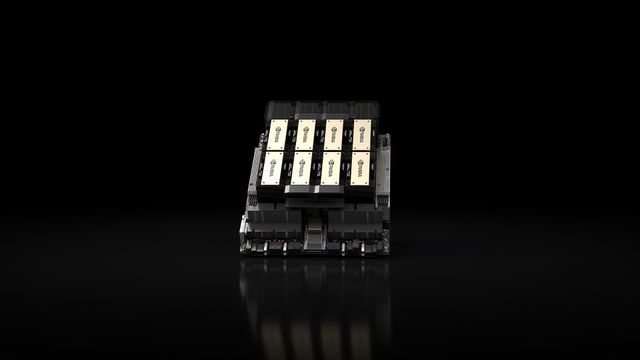

Durante a conferência Supercomputing 23, a Nvidia anunciou as novas placas H200 voltadas para segmento de HPC e Inteligência Artificial. A GPU ainda utiliza arquitetura Hopper H100, mas escalona as memórias HBM3e de 80 GB para 141 GB e velocidades de 6,25 Gbps, elevando também a largura de banda de 3,35 TB/s para 4,8 TB/s.

Outra novidade do evento foi a atualização dos superchips GH200. Enquanto o primeiro Grace-Hopper associava a CPU Amazing Grace com as GPUs H100 de 80 GB de memória HBM3, o GH200 já integra à PCB as novas H200 de 141 GB de HBM3e.

Preparando-se para as novas gerações

Apesar de promissor para o mercado de IA e computação de alto desempenho, os anúncios da Nvidia não parecem entregar, necessariamente, mais poder computacional. O escalonamento de memórias de aproximadamente 75% garante que fluxos de trabalho intensos, especialmente em LLM, não terão gargalos de desempenho por limitações de memória.

A mesma lógica se aplica aos servidores equipados com as novas versões dos superchips Grace-Hopper GH200. Seu maior diferencial é nem tanto em relação aos GH100, mas principalmente quando comparados a servidores x86. Segundo a Nvidia, os GH200 trazem até cem vezes o desempenho de servidores x86 dual-socket, e duas vezes mais eficiência energética que soluções híbridas x86 + H100.

No entanto, o salto de densidade de memórias preservando a integridade e compatibilidade das soluções atuais é uma boa amostra do que esperar para as próximas gerações. A Nvidia deve apresentar as placas com arquitetura Blackwell nos próximos meses, já com as memórias HBM3e da Micron.

Isto significa que, inicialmente, as primeiras GPUs Blackwell já contem com até 144 GB de memória HBM3e, assumindo que o projeto irá manter a mesma disposição de 6 módulos de até 24 GB. Contudo, a Micron confirmou que, já em 2025, irá aumentar a densidade dos módulos HBM3e para até 36 GB, abrindo a possibilidade para um refresh das soluções Nvidia similar a este das H100 para H200.

🛒Compre placas de vídeo Nvidia GeForce RTX com o melhor preço!

🛒Compre memórias DDR5 para PCs e Notebooks com o melhor preço!