Pesquisadores conseguem transformar pensamento em fala em novo estudo

Por Wagner Wakka | 04 de Maio de 2019 às 17h00

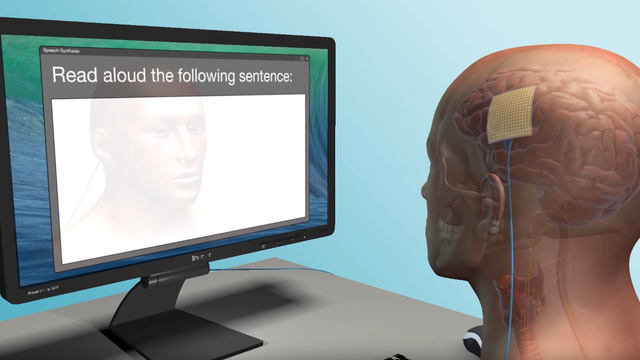

Pesquisadores da Universidade da Califórnia tiveram um avanço que consideram importante em relação a um sistema capaz de “transformar” pensamento em voz. Eles criaram uma máquina que pode gerar voz usando apenas a atividade cerebral de uma pessoa para controlar um trato vocal virtual. Isso significa criar uma simulação com uma boca virtual que emite sons semelhantes aos reais.

O projeto tem como objetivo devolver a fala para pessoas que perderam a habilidade por algum motivo, seja por derrame, trauma no cérebro ou doenças degenerativas. A ideia é fazer com que o projeto avance até o momento em que o computador seja capaz de reproduzir até mesmo o sentimento e timbre emitidos pela voz do usuários.

O estudo começou com dois pesquisadores que conseguiram mapear as formas como o cérebro “coreografa” os movimentos de boca, lábios, língua, queixo e outras partes do trato vocal para a fala. Com isso, eles conseguiram decodificar a atividade cerebral, mapeando algumas partes do cérebro, com limitações.

“A relação entre movimentos do trato vocal com sons das falas produzidas é complicada. Nós chegamos à conclusão de que se estes centros de fala no cérebro codificam mais movimentos que sons, nós podemos fazer o mesmo para decodificar estes sinais”, aponta Gopala Anumanchipalli, PhD em fonoaudiologia e um dos criadores do projeto.

Basicamente, o que eles perceberam é que, ao fazer o corpo reproduzir tais movimentos em um ambiente virtual, seria possível reproduzir tais sons, também.

Os pesquisadores usaram cinco pacientes para fazer o mapeamento por eletrodos no cérebro baseado em gravações de suas vozes. Por um sistema que chamaram de engenharia reversa, eles foram anotando todas as atividades responsáveis por movimentos, como pressionar os lábios e levantar a língua.

Esses dados foram levados a duas redes neurais com seus algorítmos. O primeiro era responsável por transformar tais dados de atividades cerebrais em movimentos para o sistema virtual criado pelos pesquisadores. Ou seja, este é o “leitor” de atividades cerebrais.

A segunda rede neural teria de reconhecer tais movimentos e transformá-los em sons sintéticos o mais próximos possível da voz dos participantes. O resultado foram frases aprimoradas, sendo criadas apenas pelas atividades cerebrais dos usuários.

Como saber se deu certo? O grupo pegou frases criadas por este sistema e pediu que um grupo de voluntários transcrevesse o que era falado. O grupo se saiu melhor quando uma lista de possibilidades de 25 opções era apresentada a eles. Eles obtiveram uma precisão de 69% ouvindo palavras de uma lista e 43% quando tinham que descrever uma sentença inteira sem apoio.

Subindo esta lista para 50 palavras, o número cai em ambos os cenários. Os principais problemas atualmente são relacionados a variações de “p” e “b”, cujos movimentos na fala são muito semelhantes.

Ainda assim, "este é um avanço em níveis de precisão, e pode ser um avanço incrível em comunicação em tempo real, comparado ao que temos atualmente disponível”, aponta Josh Chartier, estudante de graduação em bioengenharia envolvido no estudo.

O trabalho foi apresentado completamente na revista Nature em 24 de abril.