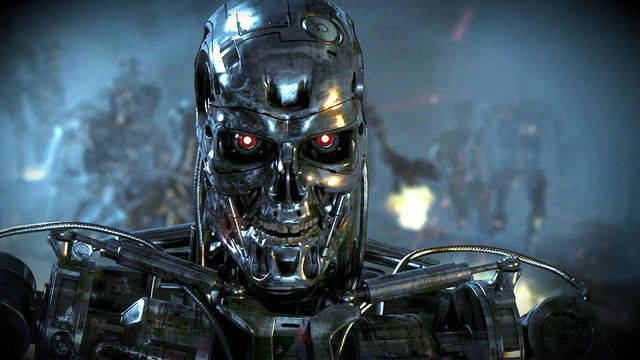

Rússia e EUA não querem que robôs assassinos sejam controlados por humanos

Por Gustavo Minari • Editado por Douglas Ciriaco | •

Os sistemas autônomos de armas letais, popularmente conhecidos como “robôs assassinos”, precisam de leis internacionais para garantir o controle humano sobre eles? Cinquenta países se reuniram na sede das Nações Unidas, na Suíça, para discutir a criação de um tratado com regulamentações específicas para proibir ou restringir o uso deste tipo de armamento.

Na contramão da maioria, representantes da Rússia acreditam que a comunidade global não necessita de novas regras que coloquem operadores humanos no comando exclusivo da tomada de decisões em situações de vida ou morte, mantendo um controle significativo sobre a responsabilidade no uso da força.

“O alto nível de autonomia dessas armas permite que elas operem em uma situação de conflito dinâmica e em vários ambientes, mantendo um fator apropriado de seletividade e precisão. Como resultado, isso garante o cumprimento das regras já existentes do Direito Internacional Humanitário”, disse um delegado da Rússia em entrevista ao jornal britânico The Telegraph.

Inteligência artificial

Um dos argumentos defendidos pela Rússia é que os algoritmos de inteligência artificial (IA), que fazem parte do sistema operacional desses robôs assassinos, já são avançados o suficiente para diferenciar amigos e inimigos, civis e militares em situações de guerra. Segundo os delegados do país de Vladimir Putin, a criação de novas regras de controle vai sobrecarregar as máquinas autônomas com regulamentos redundantes e desnecessários.

Ao lado da Rússia, países militarmente poderosos, como Israel e Estados Unidos, também consideram prematuros os movimentos para a implantação de uma nova lei de controle internacional. Essas nações investem pesado no desenvolvimento de sistemas autônomos de combate e aprendizagem de máquina, com aplicações em terra, na água e no ar.

“Matar ou ferir pessoas com base em dados coletados por sensores e processados por máquinas violaria a nossa dignidade. Depender de algoritmos para alvejar pessoas irá desumanizar a guerra e corroer nossa humanidade, produzindo efeitos imprevisíveis e inexplicáveis”, argumenta a pesquisadora da organização Human Rights Watch Bonnie Docherty.

Proibição total

Entre os 31 países que defendem a proibição total de robôs assassinos em ações militares estão Argentina, Bolívia, Brasil, Chile, Colômbia, Cuba, Equador, Egito, Iraque, Jordânia, México, Marrocos e Venezuela. Outras nações, como a China, sustentam a necessidade de regulamentação, mas são contra a exclusão geral de armas autônomas em cenários de guerra.

A ideia da criação de um tratado internacional é impedir que um robô defeituoso ou mal desenvolvido abra fogo contra civis ou fique fora de controle após sofrer uma avaria no campo de batalha. Segundo os especialistas, manter seres humanos no comando em situações críticas é fundamental para evitar tragédias e mortes de pessoas inocentes.

“Os seres humanos devem aplicar as regras do Direito Internacional Humanitário na execução de todo e qualquer tipo de ataque, de modo que as armas não compliquem essa decisão ainda mais. Nossa visão é que um algoritmo escrito para este fim não deva decidir quem vive ou morre”, encerra o assessor do Comitê Internacional da Cruz Vermelha Neil Davison.

Fonte: The Telegraph, Human Right Watch