"Robôs assassinos" são reais e já existem há mais tempo do que se imagina

Por Rafael Rodrigues da Silva | 06 de Abril de 2019 às 20h45

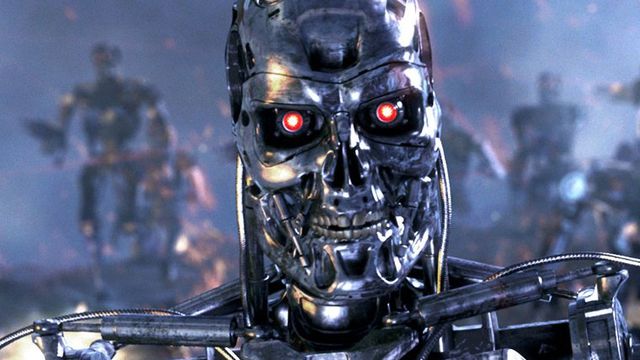

Desde que O Exterminador do Futuro se tornou um dos maiores sucessos do cinema na década de 1980, o medo de robôs assassinos deixou de ser algo exclusivo das comunidades de fãs de ficção científica para se tornar algo existente até mesmo naquelas pessoas que não são tão ligadas nos avanços da tecnologia. Afinal, os robôs são mais fortes, mais resistentes e muitas vezes possuem uma capacidade de processamento de informações maior do que a dos humanos. Então, o que os impediria de nos matar quando quisessem?

A verdade é que nada impede, e há décadas eles já nos matam.

Assassinos de metal

O debate sobre o perigo dos robôs foi retomado no começo do mês de março, quando o exército dos Estados Unidos anunciou um novo sistema de mira chamado ATLAS, que basicamente é uma IA que será instalada nos veículos de combate do exército para identificar e executar alvos com mais velocidade e precisão.

Apesar de o anúncio ter deixado a população preocupada com o papel que robôs desempenharão na destruição de vidas humanas, o ATLAS não será o primeiro do tipo a ser utilizado em combate pelo exército dos Estados Unidos — principalmente se formos utilizar a definição mais básica do que é um robô.

De acordo com a definição do dicionário, um robô pode ser qualquer forma de tecnologia que possui algum tipo de elemento autônomo, ou seja, que não precisa do auxílio humano para realizar certas tarefas. Um dos mais famosos e conhecidos exemplos da utilização de robôs em atividades militares são o uso dos SWORDS, unidades de armamento móveis controladas por controle remoto que foram muito utilizadas durante as operações do exército dos EUA no Iraque em 2007, e que são literalmente pequenos carrinhos cheios de munição e metralhadoras.

Mas, ainda que o SWORDS seja o equipamento que popularizou a ideia de que o exército utiliza robôs em suas operações de guerra, o início dessas práticas data de muitas décadas atrás — mais precisamente a década de 1940, durante a Segunda Guerra Mundial.

Robôs versus Hitler

O que provavelmente pode ser considerada como a primeira invenção de robótica para fins militares é o fusível de proximidade a rádio, usado pelos bombardeios do exército dos Estados Unidos. Esse aparelho não só media a distância da trajetória do explosivo até o alvo, como era programado para explodir a bomba quando atingisse uma distância x (por exemplo, 30m) do objeto ao qual ela deveria explodir.

Ainda que esse tipo de tecnologia não seja exatamente o que imaginamos quando pensamos em um robô, ela se encaixa na definição por automatizar um processo humano, já que até a invenção do aparelho os engenheiros deveriam calcular quanto tempo a bomba levaria para chegar ao ponto de explosão do alvo e inserir todas essas informações manualmente, e qualquer erro de cálculo ou mínimo atraso do piloto do avião para soltar essas bombas poderiam fazer com que elas errassem o alvo designado ou não causassem o estrago esperado.

Foi também durante a Segunda Guerra que o matemático Norbert Wiener começou a estudar como a cibernética poderia ser usada para melhorar a performance do soldado humano, ou até mesmo tirá-lo completamente da jogada. Foi nesses estudos que ele desenvolveu uma técnica que chamou de “feedback loop”, onde era possível, após um teste, introduzir no banco de dados da máquina as variações ocorridas naquele teste para que ela pudesse fazer uma previsão mais acertada no futuro — e foi a evolução desta técnica que resultou no que hoje chamamos de “aprendizado de máquina”, que permite o desenvolvimento de IAs cada vez mais avançadas.

Assim, fica claro notar que já passamos do tempo de discutir se devemos ou não desenvolver robôs feitos para matar humanos em campos de batalhas; eles já existem, e estão operando há muito tempo. A discussão mais correta seria focar em quando iremos utilizar esses robôs, por que eles devem ser usados, e que tipo de intervenção humana deve existir para que eles possam operar.

A ética da guerra

Ao anunciar o sistema ATLAS, o Departamento de Defesa dos Estados Unidos confirmou que nenhuma decisão de atirar em qualquer alvo será tomada sem a confirmação de um comando humano, garantindo que esse sistema não sairá atirando por aí sem que uma pessoa permita. Mas será que essa é mesmo uma “garantia” de que o aparelho não sairá por aí atacando inocentes?

A melhor comparação para o sistema seja, talvez, com os drones que o exército dos Estados Unidos utiliza em suas operações de guerra. Desde 2001, o país utilizou drones em operações no Paquistão, Iêmen, Somália, Afeganistão e Líbia e, assim como o sistema ATLAS, mesmo que um drone tenha capacidade para determinar sozinho quais os alvos que devem ser atingidos, o ataque só é concluído quando um operador humano “puxa o gatilho”, dando à máquina a permissão para atirar.

Mas é preciso fazer a reflexão: operadores de drone não são filósofos que ficam divagando sobre o valor de cada vida na sua individualidade, mas sim soldados que, como todos os outros, são treinados para um único objetivo: eliminar o inimigo. Seja no campo de batalha ou na segurança de uma sala de controle, o papel dele é o mesmo. E, se quem está indicando esse alvo é um computador, esse soldado tem mesmo o controle sobre aquilo que deve ser eliminado ou ele está apenas fazendo o trabalho de apertar o botão quando o computador fala para ele fazer isso?

Essa divagação ética do papel real do humano no controle de máquinas de matar fica ainda mais clara quando olhamos o número de vítimas inocentes desses ataques. Ainda que seja difícil precisar exatamente quantas são as vítimas civis de um ataque de drones, dados do Bureau of Investigative Journalism revelam que, no ano de 2011, apenas no Paquistão 160 crianças morreram vítimas de ataques de drones, e que mais de mil civis foram feridos.

Apesar desses números, existe um motivo bem simples de por que drones serão cada vez mais utilizados nas operações e por que o exército está sempre investindo na automação de suas tropas: o custo político de tudo isso.

Enviar tropas humanas para campos de batalha em países inimigos possui um custo político altíssimo, algo que se evita com o envio de robôs e máquinas autônomas. Isso porque o que pode colocar a população contrária à decisão do governo não é exatamente a guerra em si, mas o envio de milhares de jovens para morrer em um país estrangeiro.

Ainda pensando nesse custo político, que está o valor de se ter um ser humano para “puxar o gatilho”: mesmo que esse humano não esteja exatamente tomando nenhuma decisão, e sim apenas seguindo ordens, a simples presença dele funciona como um “escudo ético” sempre que a população começa a acusar o governo de usar robôs para matar pessoas. Porque, se é um humano que está apertando o gatilho, não é um robô autônomo matando os alvos que bem entender como em O Exterminador do Futuro, mas um soldado que está eliminando os inimigos do país — e ignoramos o fato de que é o robô que definiu pra ele quem exatamente são esses inimigos e pediu para que o soldado apenas, por gentileza, deixasse ele matar todos.

Então, há décadas estamos empoderando máquinas, tornando-as verdadeiras especialistas em matar e confiando no julgamento delas para definir em quem devemos atirar primeiro. Por isso, a discussão sobre o perigo de se utilizar armamentos autônomos já está tão ultrapassada, porque não há o que discutir: os militares já utilizam e confiam nesses armamentos em suas operações, sem nunca perguntar para a população o que achamos disso. E, para nós, só nos resta esperar que nunca sejamos considerados como um alvo potencial por essas máquinas.

Fonte: Science Alert